How To Update Qnap Firmware

This Document contains these titles;

I – Before Starting

II – How to Upgrade Firmware With Qnapfinder

III – How to Upgrade Firmware With Qnap Interface

IV – How to Upgrade Firmware With Putty

V – How to Upgrade Firmware With Qnap Live Update Feature

VI – Trouble Wih hDownloading Qnap Firmware?

VII – Qnap Firmware Update Troubleshooting;

VIII – I Got Problem With Installing Qnap Fimrware / Qnap Firmware Seem as 1.0.0 (1119T) Firmware, How Can I Fix This Problem?

I – Before Starting

For Firmware Update, you must have an installed System. You cant update Firmware without any HDD installed, except some models.

You can updgrade firmware By 4 ways;

First Download Qnap Firmware From http://www.qnap.com

After Download completes, unzip image file to your desktop;

II – How to Upgrade Firmware With Qnapfinder

Open Qnapfinder, choose your Qnap. At the top of the menus, choose tools ->firmware Update. This is the best,easiest and safe way to update,

Update Firmware by Finder

The NAS firmware can be updated by the QNAP Finder. Select a NAS model and choose “Update Firmware” from the “Tools” menu.

Login the NAS as an administrator.

Browse and select the firmware for the NAS. Click “Start” to update the system.

| Note: The NAS servers of the same model on the same LAN can be updated by the Finder at the same time. Administrator access is required for system update. |

III – How to Upgrade Firmware With Qnap Interface

Login Qnap and go Administration page ->firmware update and show your Qnap image file.

Update Firmware by Web Administration Page

| Note: If the system is running properly, you do not need to update the firmware. |

| 1. | Download the release notes of the firmware from the QNAP website http://www.qnap.com. Read the release notes carefully to make sure it is required to update the firmware. |

| 2. | Download the NAS firmware and unzip the IMG file to the computer. |

| 3. | Before updating the system firmware, back up all the disk data on the NAS to avoid any potential data loss during the system update. |

| 4. | Click “Browse” to select the correct firmware image for the system update. Click “Update System” to update the firmware. |

IV – How to Upgrade Firmware With Putty

1 – Download Qnap firmware, and unzip it to Public Folder. Your Unzipped Image file should be looking like this : 809U_3.4.2_Build0331.img

2 – Login Qnap via Putty and type this commands;

# mv /share/Public/TS-809U_3.4.2_Build0331.img /mnt/HDA_ROOT/update/

# ln -sf /mnt/HDA_ROOT/update /mnt/update

# /etc/init.d/update.sh /mnt/HDA_ROOT/update/TS-809U_3.4.2_Build0331.img

just reboot the device with this command;

# reboot

From : http://forum.qnap.com/viewtopic.php?p=236036

V – How to Upgrade Firmware With Qnap Live Update Feature

Trust me and stay away from this option. But If you want to learn how;

Live Update

Select “Enable live update” to allow the NAS to automatically check if a new firmware version is available for download from the Internet. If a new firmware is found, you will be notified after logging in the NAS as an administrator.

Click “CHECK FOR UPDATE” to check if any firmware update is available.

Note that the NAS must be connected to the Internet for these features to work.

.

VI – Trouble With Downloading Qnap Firmware?

First, go http://www.qnap.com, then Support ->Download

Choose your NAS device from Category, and your NAS model at the right Dropdown menu. If your device model is not in that list, Choose “Archive” from the left dropdown menu.

You can Choose older firmware if you want. Download from Europe;

After Download completes, you can Install Firmware.

.

VII – Qnap Firmware Update Troubleshooting;

Qnap gives error when I try to install firmware;

Make sure you have an installed device, then try to update firmware

Make sure you download right firmware. Ts-459 and Ts-459U firmware is not the same thing.

If you still get probem about installing firmeware, Please contact with Qnap support.

Qnap Firmware Stuck at %20;

Download a lower Firmware version from this link;

http://web.qnap.com/download.asp

Choose an older Firmware with swithing right dropdown menu with “All”

Restart Qnap and try firmware update again.

VIII – I Got Problem With Installing Qnap Fimrware / Qnap Firmware Seem as 1.0.0 (1119T) Firmware, How Can I Fix This Problem?

How to Fix;

1 – NAS Firmware Update When No HDD(s) Installed

From QNAPedia

NOTE:

- This procedures are used to update the flash / DOM (disk on module) firmware on the NAS.

- Make sure no HDD installed before update.

- Flash image are required for NAS with 16MB flash or 128MB DOM.

- For NAS with 512MB DOM, just use the firmware on QNAP download site (http://www.qnap.com/download.asp).

- This updated procedures are generally used when the NAS can be found by QNAP Finder but cannot be initialized with HDD(s).

- QNAP NAS also store firmware on the HDDs. If you have initialized the NAS with HDDs before, this update procedures will cause the firmware version mismatch between the NAS and the HDDs. You need to update the firmware again after boot up with HDDs installed.

2 – Update Procedures:

- Power off the NAS

- Remove all the HDDs

- Power on the NAS

- After a short beep and a long beep(about two minutes after first short beep), run the QNAP Finder(Make sure the Finder is the latest version).

- QNAP Finder should find the NAS and its IP

- Select the NAS and click “Tools” -> “Update Firmware”

- Input default username and password (admin/admin)

- Select the image files on your PC for the NAS.

- After firmware update, the NAS will be reboot.

- Make sure the firmware have been updated

- Power off the NAS

- Plug all the HDD back

- After power on, follow the messages on the Finder to initialize the NAS.

From : http://wiki.qnap.com/w/index.php?title=NAS_Firmware_Update_When_No_HDD(s)_Installed

Obtained from this link

Instalación de KMS

1. Introducción

En el post anterior se habló de las opciones para activar Windows usando las claves MAK o KMS. En esta ocasión pondré el procedimiento paso a paso de la instalación del servicio, sobre un servidor con Windows 2008 R2 (opción recomendada).

Algo que quiero hacer notar, es que este servicio es «ultraliviano», por lo que bajo ningún caso se requiere un servidor dedicado, a menos que las políticas internas de la empresa lo dicten así.

2. Instalación del servicio KMS

2.1 Obtención de la clave KMS

Para obtener las claves KMS o MAK, se debe acceder al sitio https://www.microsoft.com/licensing/servicecenter/home.aspx, e ingresar con una cuenta passport que esté registrada con el contrato de licenciamiento correspondiente. Una vez en el sitio, entonces se debe buscar claves como las de la imagen:

Con la clave de Windows 7, se puede activar Windows 7 y Windows Vista, con la clave Windows Server 2008 R2, se puede activar Windows Servers y Windows 7 y Vista. Es decir, la versión superior de clave KMS abarca a los otros productos.

El proceso de instalación, en un servidor Windows 2008 R2 o Windows 7 es el siguiente:

- Inciar sesión con credenciales de administrador en el servidor donde se dejará el servicio

- Clic en el botón Start -> All Programs -> Accesories

- Clic derecho sobre Command Prompt y luego clic en Run as administrator

- En la consola de comandos escribir cd C:\Windows\system32 y luego presionar la tecla enter

- Ejecutar cscript.exe slmgr.vbs /ipk AAAAA-BBBBB-CCCCC-DDDDD-EEEEE, donde AAAAA-BBBBB-CCCCC-DDDDD-EEEEE es la clave KMS para Windows Server 2008 R2 o Windows 7 que debe ser obtenida desde el sitio de licenciamiento. Con esto se mostrará un resultado como el de la imagen.

2.2 Habilitación del servicio en el Firewall de Windows

Para que el servicio atienda a los clientes, debe permitirse en el firewall de Windows.

Para configurar el servicio KMS en el firewall:

- Inciar sesión con credenciales de administrador en el servidor CLSCLKMSPRD

- Clic en el botón Start -> Control Panel

- Clic en System and Security

- Clic en Windows Firewall

- Clic en Allow a program of feature trough Windows Firewall

- Clic en Key Management Service y luego marcar la columna de Domain

- Clic en OK

Debe quedar configurado como muestra la figura.

2.3 Creación de registro DNS

Para que los equipos clientes puedan encontrar al servidor que provee la activación en la red interna, se debe crear un registro DNS de tipo SRV. Por omisión los clientes buscarán este registro y solicitaran la activación al servidor correspondiente.

Para crear el registro DNS:

- Ingresar al servidor DNS con credenciales de administrador (generalmente es el mismo servidor controlador de dominio o Active Directory)

- Abrir la consola DNS

- Expandir Forward Lookup Zones

- Expandir la zona DNS correspondiente al dominio de los equipos, en este caso Arauco.cl

- Clic derecho sobre _tcp y clic en Other New records

- En la lista hacer clic sobre Service Location (SRV) y luego en el botón Create Record

- Llenar los siguientes campos:

- Service = _VLMCS

- Protocol = _tcp

- Priority = 0

- Weight = 0

- Port Number = 1688

- Host offering this service = «nombre fqdn del servidor kms, por ejemplo: KMS01.Contoso.com»

- Clic en OK

2.4 Revision del servicio KMS

Para revisar el estado del servicio KMS:

- Iniciar sesión con credenciales de administrador en el servidor KMS

- Clic en el botón Start -> Run..

- Escribir CMD.exe

- En la consola de comandos escribir cd C:\Windows\system32 y luego presionar la tecla enter

- Ejecutar cscript.exe slmgr.vbs /dlv

- Se deberá obtener un resultado como el de la figura.

Dónde:

- Comando para ver el estado del servicio

- Número rearm disponibles para resetear el estado de activación (sólo son 3 por default)

- Cantidad de máquinas que han solicitado activación. Este número debe ser mayor a 5 para comenzar a activar servidores Windows 2008 y superiores, y mayor a 25 para comenzar a activar equipos con Windows Vista o Windows 7.

- Número de requerimientos recibidos, esto puede ser mayor que el número de máquinas, ya que una máquina puede generar varios requerimientos hasta ser activada.

Con lo anterior ya tendríamos el servicio funcionando, por lo que el paso siguiente es empezar a acumular clientes para comenzar a activar.

3. Activación de clientes

Debe tomarse en cuenta que las versiones empresariales de Windows Vista, 7, 2008 y 2008 R2 y Office 2010 son clientes KMS por default, por lo que una vez que el servicio está funcionando, los equipos clientes se activarán automáticamente, sin necesidad de realizar intervenciones manuales. Sin embargo, en el caso de que se requiera activar un equipo, existen dos formas de hacerlo:

3.1 Entorno gráfico en el PC

- Iniciar sesión en el equipo cliente con credenciales de administrador

- Clic en Inicio

- Clic derecho sobre Computador y luego en Propiedades

- Navegar a la sección Activación de Windows

- Clic sobre Activar Windows Ahora

3.2 Usando script:

El método de script está recomendado en los casos de despliegue automático o cuando se requiere de realizar troubleshooting con respecto a la activación de los equipos.

Para activar un equipo usando script:

- Iniciar sesión con credenciales de administrador en el equipo cliente

- Clic en el botón Start -> Run..

- Escribir CMD.exe

- En la consola de comandos escribir cd C:\Windows\system32 y luego presionar la tecla enter

- Ejecutar cscript.exe slmgr.vbs /ato

- Debe aparecer un mensaje como el siguiente:

Visualmente se puede comprobar que un equipo está activado cuando en la propiedades aparece un logo como este:

A estas alturas seguramente habrá gente opinando «pero cómo?? y no hay una consola??», por lo que en el siguiente post, decribiré la instalación de la consola VAMT y sus utilizaciones.

Activación de Windows

Introducción

En muchos empresas me he encontrado con casos donde se utilizan claves de activación equivocadas o desconocimiento del significado/utilización de la clave KMS o MAK. Estas claves nacieron con Windows Vista, pero debido a la gran adopción de Windows 7, se han hecho más utilizadas ahora. En esta serie de post, describiré las características de cada clave, sus implicancias y el procedimiento de instalación de un servidor KMS.

La activación de Windows usando claves MAK o KMS, se requiere para los productos Windows Vista, 2008, 7 y 2008 R2 y de ellos en adelante. Sin embargo, el proceso de activación es algo que se empezó a utilizar desde el viejo y querido Windows XP.

Pues bien, como mi primer post, les quiero dejar información aclaratoria de cuales son las diferencias y las ventajas de cada método. Luego, en las siguientes secciones, podrán encontrar información relacionada a la implementación del servicio KMS.

En primer lugar debemos dejar en claro algunos puntos:

- La activación de un producto (en este caso Windows), es la validación del mismo con el fabricante.

- Tanto la clave MAK como la clave KMS, se pueden obtener desde el sitio de licenciamiento del cliente. Es decir, cada cliente que compre productos Microsoft (en cantidades), tiene acceso al sitio de licenciamiento eOpen (http://eopen.microsoft.com), desde donde se pueden descargar productos y las claves correspondientes a ellos. Para tener acceso a dicho sitio, es necesario tener un contrato de licenciamiento o ser el administrador del sitio de licenciamiento del cliente.

- Las licencias pueden ser obtenidas a través del retail (ej: un PC adquirido en una tienda comercial), OEM (PC comprado al fabricante de hardware y que viene con SO) o por Volumen (sistema utilizado por las empresas con un número grande de equipos).

- Un equipo tiene 30 días para activarse, luego de lo cual entra en modo «reducido» (fondo de pantalla negro, etc).

Activación por MAK (Multiple Activation Key)

Esta clave es una cadena de 25 caracteres que se ingresa al momento de ejecutar el wizard de activación, una alternativa (si no se tiene la clave) es activar el producto por vía telefónica, siguiendo las instrucciones del mismo wizard. La activación por este método se realiza sólo una vez por instalación de Windows.

Si bien eta es la forma «clásica» (históricamente estamos acostumbrados a ingresar una key), existen casos en que no se recomienda por motivos de seguridad y optimización de tiempo. Cada vez que se activa un equipo usando este método, debe existir una persona (técnico) que realice el trabajo. Si tomaramos como promedio que un técnico puede llegar a tardar 15 minutos en realizar el proceso, en una empresa con 1000 equipos, gastaría 250 hrs (32 días hábiles), sólo en esta tarea (eso sin tomar en cuenta que los equipos pueden ser reinstalados por algun motivo). Además, desde el punto de vista seguridad, si un cliente deja en manos de terceros la instalación de sus equipos, deberá entregarles las claves MAK, con lo que perderá el control de cuantos equipos serán instalados con dicha clave. Este último punto es relevante, ya que las claves MAK son acotadas (ej: 1000) y para obtener más, se debe pagar un costo.

Activación por KMS (Key Management Service)

KMS es un servicio que se instala en un servidor (recomendado) de la red interna o una estación de trabajo. Cumple con la función de activar Windows (u Office 2010) de forma automática sin necesidad de ingresar la clave de 25 caracteres. Este método está pensado para ambientes de empresa donde hay más de 25 equipos a activar (requisito mínimo de activaciones). Además, la implementación de este servicio, evita que todos los equipos de la red se conecten a Internet para realizar la activación.

Para identificar la clave KMS se debe buscar en el sitio de licenciamiento una key del tipo «Windows 7 Enterprise KMS Key» o «Windows 2008 Standard KMS Key». Es necesario obtener estas key desde el sitio de licenciamiento, ya que éstas son renovadas junto con el contrato de licenciamiento, por ende de un año a otro pueden variar.

Algo importante es que la clave KMS se debe utilizar sólo para instalar dicho servicio, y NO para activar los PC o servidores, en otras palabras, cuando un equipo pida activación NO SE DEBE INGRESAR LA CLAVE KMS. Este es un error típico, pero que es totalmente solucionable, sin necesidad de reinstalar el sistema operativo.

En el próximo post, indicaré pasos básicos para la instalación de un servidor KMS.

Usando BgInfo

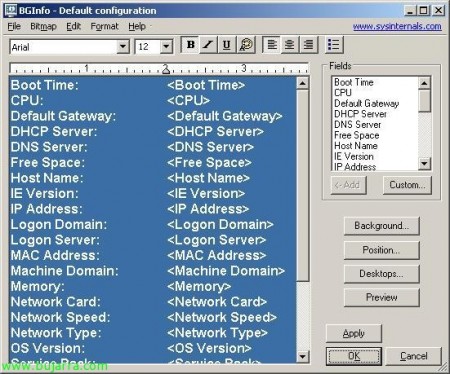

BgInfo es la típica utilidad de toda la vida (por cierto, cómo no, de Sysinternals) que nos puede servir para aclararnos un poco la vida, sobre todo si andamos en entornos grandes y desconocemos en qué servidor andamos logueándonos, o para hacer demos o cursos y que los alumnos vean cláramente en qué servidor estamos. Es una aplicación totalmente parametrizable en la que nos mostrará bastante información sobre el equipo donde se ejecuta. Podemos configurar que muestre en pantalla (combinado con el fondo de pantalla) el nombre del equipo, su dirección IP, sistema operativo, nivel de service pack, hora de arranque, tipo de CPU, puerta de enlace, máscara de red, servidores DNS, servidor DHCP, espacio libre en discos, discos duros disponibles, versión de Internet Explorer, dominio al que pertenece, controlador de dominio que le validó, Memoria RAM, tarjeta de red, velocidad de la red, tipo de equipo, usuario en uso, dominio logueado…

Bueno, podemos descargarlo gratuitamente de su web oficial (http://technet.microsoft.com/en-us/sysinternals/bb897557.aspx), lo ejecutamos en un equipo y ahí en tenemos las opciones para configurarlo, podemos seleccionar los campos que nos interesa que se vea, así como modificar cualquier necesidad, como el tamaño de la letra, idioma (manualmente)… si le damos a “Apply” se nos aplicará esa configuración en el equipo donde lo estemos ejecutando.

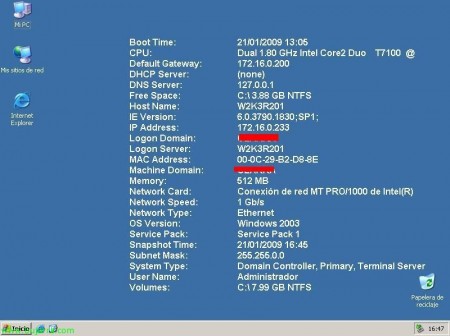

Y quedaría tipo esto, puede que no nos interese como está, podemos configurar lo que queremos que se vea y por supuesto mediante directivas del Directorio Activo para poder ejecutarlo en todos nuestros servidores o PC’s.

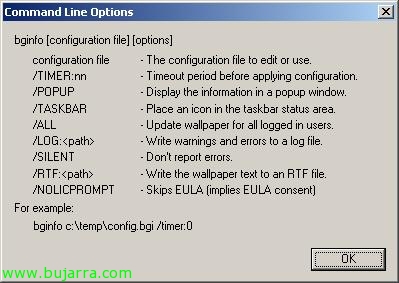

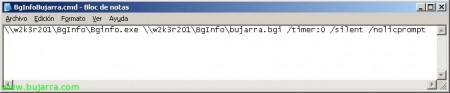

Estos son los parámetros que tenemos sobre el ejecutable bginfo.exe, pudiendo configurar el tiempo de espera a que se aplique el fondo (/timer), con ‘/popup’ en una ventana emergente, ‘/taskbar’ pondrá un icono en la barra de herramientas, con ‘/all’ conseguimos que se aplique a todos los usuarios logueados en el servidor, ‘/log’ nos generará logs, ‘/silent’ para que si hay errores no los muestre, ‘/rtf’ nos generará un archivo de ese formato con la info, y con ‘/nolicprompt’ evitaremos que nos pregunte por el acuerdo de licencia.

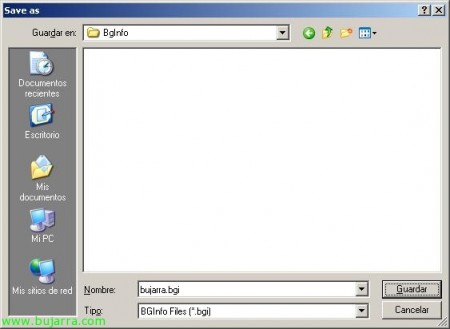

Así que abrimos Bginfo, nos configuramos la plantilla como queremos que sea, tipo letra, blablaba… y lo guardamos “File” > “Save As…”, en mi caso será algo parecido a:

—————————————

Nombre de equipo:

Hora de encendido:

CPU:

Memoria:

Disco duro:

Dirección IP:

Máscara de red:

Puerta de enlace:

Servidor DHCP:

Servidor DNS:

Dirección MAC:

Espacio libre:

Dominio:

Sistema Operativo:

Usuario:

—————————————–

Indicamos un nombre .bgi & “Guardar”,

Y ahora mediante un simple script lo podemos ejecutar en todos los equipos que nos interese, ejemplo:

\SERVIDORBgInfoBginfo.exe \SERVIDORBgInfobujarra.bgi /timer:0 /silent /nolicprompt

Y así quedaría nuestro fondo!

Using a Reverse Proxy to Automatically Force External Lync Meeting Guests to Use Silverlight Client

https://lync.contoso.com/meet/username/EJHFSN and you are not a part of the Contoso organization and you do not have federation set up or do not allow automatic discovery of federated partners, it will fail with a useless numeric error code that means absolutely nothing. Since the desktop client does not allow you log on anonymously, it will never fallback to guest logon, even if the meeting organizer has it enabled for the meeting. TechNet to the rescue! All you have to do is append “sl=1” to the end of the query string of the URL, so that you visit https://lync.contoso.com/meet/username/EJHFSN?sl=1 and then it will force the Silverlight client, which will allow you to log on anonymously. In this scenario, Lync meetings then behave basically like WebEx or GotoMeeting, where external participants need a browser plugin to connect to the meeting. Perfect. That’s exactly what I want. Again, one problem. Imagine trying to get your entire staff to always remember to append that to the meeting link when they set up external meetings. Despite best efforts, it’s just not going to happen. Your CFO has better things to do and she will forget, because that is human nature. And, really, this is Microsoft’s shortsightedness here. You can read my comment at the TechNet article linked above.

Thanks for the «?sl=1» trick. That did the trick for me. But explaining this to my users is going to be a pain. Imagine me in the CFO’s office after months of extolling the virtues of Lync and how we even got rid of our WebEx subscription because, heck, Lync does meetings too! But suddenly, a meeting participant is also using Lync at his company but we have no federated relationship with each other, so when we click on each other’s meeting links it just fails with a terrible numerical error. «I thought this thing could replace WebEx,» the CFO bellows, scowling at me in disdain. «Oh, it can,» I reply, «just make sure you modify every meeting invitation so that the URL has ?sl=1 at the end of it!» Yea, that will go over well.

Thankfully, there is a workaround. And due to the way Lync is designed, it’s really not difficult to set up. When you set up your Lync websites, it creates an internal and external site. The external site by default uses the non-standard ports 8080 and 4443. The Lync best practice is to use a Reverse Proxy or firewall port forwarding rules to send traffic destined for the normal web ports to the Lync alternate ports. Your internal users, on the other hand, use ports 80 and 443 as normal, directly communicating with the Lync server. Reverse proxies can also be set up to modify URLs before the connection is sent to the backend. This is known as URL Rewriting. In this case, you want a URL rewrite rule that will modify connections to /meet/ such that ?sl=1 is always added to the end. I found from trial and error that you get the best results by only modifying the /meet/ part of the above URL (assuming you are using Simple URLs like that). So I set up my topology so that 8080 and 4443 were exposed directly to the outside so I have an option to bypass the reverse proxy once the connection is established. This is all completely secure and transparent to the end user. We’re not bypassing the firewall, just the reverse proxy’s URL rewriting when it is not needed. So the final topology looks like this. (The Lync Front End is either your Edge server or your single server depending on the size of your deployment.) From outside my firewall, ports 80, 443, 8080, and 4443 are all open. If you connect to 80 or 443, you are sent to the reverse proxy. If you go to 8080 or 4443, you are sent directly to Lync. To prepare Lync for this configuration, I first edited the topology so that the published ports are assigned the same as the internal (8080 and 4443) as this will allow us to bypass the reverse proxy when it is not needed.

Whenever you publish your topology, remember to rerun the Lync setup wizard. The reverse proxy can be easily created using IIS. In fact, you can set it up on your Lync edge server if you want. It depends on your workload. For the purposes of this post, we’ll assume you are setting it up on the same server. Note: Lync will stop any non-Lync website in IIS whenever you publish your topology and rerun setup, so be prepared for this! In order to configure the reverse proxy, you need to install the Application Request Routing and URL Rewrite extensions for IIS. These both should already be installed if you are using your Lync server. Enable the Application Request Routing. This is done at the server level. Click on your IIS server in the IIS manager, double click Application Request Routing Cache, then click on Server Proxy Settings. Check Enable proxy and keep everything else at defaults.

Create a new website. Give it a folder path that is not shared with any other site (i.e., don’t reuse C:\Inetpub\wwwroot). The bindings should be whatever the external IP address is mapped to through your firewall. Bind HTTP and HTTPS on the default ports. Make sure you use a different internal IP address than your Lync internal website so there isn’t a collision. You don’t want internal users going through the reverse proxy. Go into the site’s URL Rewrite section and create a dummy rule. We are going to overwrite this later, so it doesn’t matter what it is. We just want to create a web.config that we can edit by hand. Edit the web.config “rules” section for the reverse proxy site. Now here is where the fun begins. We are going to modify any request that goes to /meet/ so that it has sl=1 at the end. I created a rule for both HTTP and HTTPS since I am using default Lync ports (non-standard web ports). There is also a condition that if the query string already contains sl=, it will not modify it. Underneath the /meet/ rewrites are the default rules that just pass the request through unmodified to the correct ports. Obviously, URLs, RegEx, ports, and so on, will all need to be modified to match your environment.

< rules> < rule name="ReverseProxyInboundRule1" stopProcessing="true"> < match url="^meet/(.*)" /> < conditions> < add input="{QUERY_STRING}" pattern="(.*)sl=(.*)" negate="true" /> < add input="{CACHE_URL}" pattern="^(https)://" /> conditions> < action type="Rewrite" url="{C:1}://lync.contoso.com:4443/{R:0}?sl=1&{QUERY_STRING}" appendQueryString="false" logRewrittenUrl="true" /> rule> < rule name="ReverseProxyInboundRule2" stopProcessing="true"> < match url="^meet/(.*)" /> < conditions> < add input="{QUERY_STRING}" pattern="(.*)sl=(.*)" negate="true" /> < add input="{CACHE_URL}" pattern="^(http)://" /> conditions> < action type="Rewrite" url="{C:1}://lync.contoso.com:8080/{R:0}?sl=1&{QUERY_STRING}" appendQueryString="false" logRewrittenUrl="true" /> rule> < rule name="ReverseProxyInboundRule3" stopProcessing="true"> < match url="(.*)" /> < conditions> < add input="{CACHE_URL}" pattern="^(https)://" /> conditions> < action type="Rewrite" url="{C:1}://lync.contoso.com:4443/{R:1}" appendQueryString="true" logRewrittenUrl="true" /> rule> < rule name="ReverseProxyInboundRule4" stopProcessing="true"> < match url="(.*)" /> < conditions> < add input="{CACHE_URL}" pattern="^(http)://" /> conditions> < action type="Rewrite" url="{C:1}://lync.contoso.com:8080/{R:1}" appendQueryString="true" logRewrittenUrl="true" /> rule> rules>

If you attempt to connect to a meeting externally now, this is what happens.

- Browser initiates connection to https://lync.contoso.com/meet/username/EJHFSN.

- Reverse Proxy receives the request, adds sl=1 to the query string, and passes the request to the external Lync website at https://lync.contoso.com:4443/meet/username/EJHFSN?sl=1.

- Lync server replies and tells the browser to load the Silverlight Lync client which then attempts to connect directly to the lync web services (bypassing the Reverse Proxy) at https://pool1.lync.contoso.com:4443/Reach/Client/WebPages/ReachClient.aspx.

- The external user can join as an anonymous guest, or log on using the domain credentials of the organizer’s meeting, if they have that. The desktop Lync client will never launch!

Hopefully in the future Microsoft will fix the desktop client to allow it to log on anonymously to external meetings and also give us a checkbox in the Lync Server Control Panel that allows us to force all external connections to the Silverlight client (for legacy organizations that might connect to ours).

Setting up a Reverse Proxy using IIS, URL Rewrite and ARR

Today there was a question in the IIS.net Forums asking how to expose two different Internet sites from another site making them look like if they were subdirectories in the main site.

So for example the goal was to have a site: www.site.com expose a www.site.com/company1 and a www.site.com/company2 and have the content from “www.company1.com” served for the first one and “www.company2.com” served in the second one. Furthermore we would like to have the responses cached in the server for performance reasons. The following image shows a simple diagram of this:

This sounds easy since its just about routing or proxying every single request to the correct servers, right? Wrong!!! If it only it was that easy. Turns out the most challenging thing is that in this case we are modifying the structure of the underlying URLs and the original layout in the servers which makes relative paths break and of course images, Stylesheets (css), javascripts and other resources are not shown correctly.

To try to clarify this, imagine that a user requests using his browser the page at http://www.site.com/company1/default.aspx, and so based on the specification above the request is proxied/routed to http://www.company1.com/default.aspx on the server-side. So far so good, however, imagine that the markup returned by this HTML turns out to have an image tag like “<img src=/some-image.png />”, well the problem is that now the browser will resolve that relative path using the base path on the original request he made which was http://www.site.com/company1/default.aspx resulting in a request for the image at http://www.site.com/some-image.png instead of the right “company1” folder that would be http://www.site.com/company1/some-image.png .

Do you see it? Basically the problem is that any relative path or for that matter absolute paths as well need to be translated to the new URL structure imposed by the original goal.

So how do we do it then?

Enter URL Rewrite 2.0 and Application Request Routing

URL Rewrite 2.0 includes the ability to rewrite the content of a response as it is getting served back to the client which will allow us to rewrite those links without having to touch the actual application.

Software Required:

- IIS 7.0 or IIS 7.5 (included in Windows Vista, Windows 2008, Windows 7 or Windows 2008 R2).

- Install URL Rewrite 2.0

- Install Application Request Routing

Steps

- The first thing you need to do is enable Proxy support in ARR.

- To do that just launch IIS Manager and click the server node in the tree view.

- Double click the “Application Request Routing Cache” icon

- Select the “Server Proxy Settings…” task in the Actions panel

- And Make sure that “Enable Proxy” checkbox is marked. What this will do is allow any request in the server that is rewritten to a server that is not the local machine will be routed to the right place automatically without any further configuration.

- Configure URL Rewrite to route the right folders and their requests to the right site. But rather than bothering you with UI steps I will show you the configuration and then explain step by step what each piece is doing.

- Note that for this post I will only take care of Company1, but you can imagine the same steps apply for Company2, and to test this you can just save the configuration file below as web.config and save it in your inetpub\wwwroot\ or in any other site root and you can test it.

<configuration>

<system.webServer>

<rewrite>

<rules>

<rule name=»Route the requests for Company1″ stopProcessing=»true»>

<match url=»^company1/(.*)» />

<conditions>

<add input=»{CACHE_URL}» pattern=»^(https?)://» />

</conditions>

<action type=»Rewrite» url=»{C:1}://www.company1.com/{R:1}» />

<serverVariables>

<set name=»HTTP_ACCEPT_ENCODING» value=»» />

</serverVariables>

</rule>

</rules>

<outboundRules>

<rule name=»ReverseProxyOutboundRule1″ preCondition=»ResponseIsHtml1″>

<match filterByTags=»A, Area, Base, Form, Frame, Head, IFrame, Img, Input, Link, Script» pattern=»^http(s)?://www.company1.com/(.*)» />

<action type=»Rewrite» value=»/company1/{R:2}» />

</rule>

<rule name=»RewriteRelativePaths» preCondition=»ResponseIsHtml1″>

<match filterByTags=»A, Area, Base, Form, Frame, Head, IFrame, Img, Input, Link, Script» pattern=»^/(.*)» negate=»false» />

<action type=»Rewrite» value=»/company1/{R:1}» />

</rule>

<preConditions>

<preCondition name=»ResponseIsHtml1″>

<add input=»{RESPONSE_CONTENT_TYPE}» pattern=»^text/html» />

</preCondition>

</preConditions>

</outboundRules>

</rewrite>

</system.webServer>

</configuration>

Setup the Routing

<rule name=»Route the requests for Company1″ stopProcessing=»true»>

<match url=»^company1/(.*)» />

<conditions>

<add input=»{CACHE_URL}» pattern=»^(https?)://» />

</conditions>

<action type=»Rewrite» url=»{C:1}://www.company1.com/{R:1}» />

<serverVariables>

<set name=»HTTP_ACCEPT_ENCODING» value=»» />

</serverVariables>

</rule>

The first rule is an inbound rewrite rule that basically captures all the requests to the root folder /company1/*, so if using Default Web Site, anything going to http://localhost/company1/* will be matched by this rule and it will rewrite it to www.company1.com respecting the HTTP vs HTTPS traffic.

One thing to highlight which is what took me a bit of time is the “serverVariables” entry in that rule that basically is overwriting the Accept-Encoding header, the reason I do this is because if you do not remove that header then the response will likely be compressed (Gzip or deflate) and Output Rewriting is not supported on that case, and you will end up with an error message like:

HTTP Error 500.52 – URL Rewrite Module Error.

Outbound rewrite rules cannot be applied when the content of the HTTP response is encoded («gzip»).

Also note that to be able to use this feature for security reasons you need to explicitly enable this by allowing the server variable. See enabling server variables here.

Outbound Rewriting to fix the Links

The last two rules just rewrite the links and scripts and other resources so that the URLs are translated to the right structure. The first one rewrites absolute paths, and the last one rewrites the relative paths. Note that if you use relative paths using “..” this will not work, but you can easily fix the rule above, I was too lazy to do that and since I never use those when I create a site it works for me 🙂

Setting up Caching for ARR

A huge added value of using ARR is that now we can with a couple of clicks enable disk caching so that the requests are cached locally in the www.site.com, so that not every single request ends up paying the price to go to the backend servers.

- To do that just launch IIS Manager and click the server node in the tree view.

- Double click the “Application Request Routing Cache” icon

- Select the “Add Drive…” task in the Actions panel.

- Specify a directory where you want to keep your cache. Note that this can be any subfolder in your system.

- Make sure that “Enable Disk Cache” checkbox is marked in the Server Proxy Settings mentioned above.

As easy as that now you will see caching working and your site will act as a container of other servers in the internet. Pretty cool hah! 🙂

So in this post we saw how with literally few lines of XML, URL Rewrite and ARR we were able to enable a proxy/routing scenario with the ability to rewrite links and furthermore with caching support.

iSCSI Best Practices (Microsoft, EMC, VMware) – Summarized

This document summarizes the best practices of iSCSI usage as described in the following guides from MS, EMC, and VMware.

MS & iSCSI –

Exchange:

– Microsoft Exchange Server can store its program files, mailboxes, public folders, logs and other data on iSCSI disk volumes in both cluster and non cluster configurations.

– Keep the Exchange disks in a separate pool on the array.

SQL Server – Microsoft SQL Server can store its program files, logs and other data on iSCSI disk volumes in both cluster and non cluster configurations

NOTE: iSCSI initiator does not support Dynamic disk volumes and NIC teaming.

iSNS – Microsoft iSNS Server is a Microsoft Windows service that processes iSNS registrations, de-registrations, and queries via TCP/IP from iSNS clients, and also maintains a database of these registrations. iSNS servers can be clustered.

iSCSI Boot:

– Windows can be booted off of an iSCSI disk however; the iSCSI boot initiator will disable all kernel mode code paging. Additionally the pagefile must not be located on an iSCSI disk.

– Windows Server 2003 can be booted from a SAN using either an FC HBA or an iSCSI HBA

iSCSI Best Practices:

– Deploy on fast networks – at least a GigE or better network

– Ensure physical security

– Use strong passwords for all accounts

– Use CHAP authentication because that ensures each host has its own password. Mutual CHAP authentication is even better. Use One Way or Mutual CHAP

– Use iSNS for discovery

– Segregate iSCSI SANs from LAN traffic

– Use IPsec

– Use Access Control or LUN masking

Networking Best Practices for iSCSI:

– Use non blocking switches and set the negotiated speed on the switches.

– Disable unicast storm control on iSCSI ports. Most switches have unicast storm control disabled by default.

– Enable Flow Control on network switches and adapters; flow control ensures a receiver can make the sender pace its speed and is important in avoiding data loss.

– Ensure spanning tree algorithm for detecting loops is turned off on the ports used for iSCSI traffic.

– Segregate SAN and LAN traffic. iSCSI SAN interfaces should be separated from other corporate network traffic (LAN). Servers should use dedicated NICs for SAN traffic. Deploying iSCSI disks on a separate network helps to minimize network congestion and latency. Additionally, iSCSI volumes are more secure when… Segregate SAN & LAN traffic can be separated using port based VLANs or physically separate networks.

– Configure additional Paths for High Availability; use either Microsoft MPIO or MCS (multiple connections per session) with additional NICs in the server to create additional connections to the iSCSI storage array through redundant Ethernet switch fabrics.

– Unbind File and Print Sharing from the iSCSI NIC – on the NICs which connect only to the iSCSI SAN, unbind File and Print Sharing.

– Use Gigabit Ethernet connections for high speed access to storage. Congested or lower speed networks can cause latency issues that disrupt access to iSCSI storage and applications running on iSCSI devices. In many cases, a properly designed IP-SAN can deliver better performance than internal disk drives.

– iSCSI is suitable for WAN and lower speed implementations including replication where latency and bandwidth are not a concern.

– Use Server class NICs. It is recommended to use NICs which are designed for enterprise networking and storage applications.

– Use CAT6 rated cables for Gigabit Network Infrastructures. For 10Gigabit implementations, Cat-6a or Cat-7 cabling is usually required for use with distances over 55 meters.

– Use Jumbo Frames if supported in your network infrastructure. Jumbo Frames can be used to allow more data to be transferred with each Ethernet transaction and reduce the number of frames. This larger frame size reduces the overhead on both your servers and iSCSI targets. For end to end support, each device in the network needs to support Jumbo frames including the NIC and Ethernet switches.

Redundancy & Load Balancing:

There are two technologies supported with the MS iSCSI software initiator to enable redundancy and load balancing:

– Multiple connections per session (MCS) – Multiple connections per session (MCS) support is defined in the iSCSI RFC to allow multiple TCP/IP connections from the initiator to the target for

-the same iSCSI session. This is iSCSI Protocol specific. In this way I/O can be sent over either TCP/IP connection to the target. If one connection fails another connection can continue processing I/O without interruption to the application. Note that not all iSCSI targets support MCS.

– Microsoft MPIO support

There are a number of things to consider when choosing to use MCS or Microsoft MPIO for multipathing.

– If your configuration uses hardware iSCSI HBA then Microsoft MPIO should be used.

– If your target does not support MCS then Microsoft MPIO should be used. Most iSCSI target arrays support Microsoft MPIO.

– If your target does support MCS and you are using the Microsoft software initiator driver then MCS is the best option. There may be some exceptions where you desire a consistent management interface among multipathing solutions and already have other Microsoft MPIO solutions installed that may make Microsoft MPIO an alternate choice in this configuration.

– If you need to specify different load balance policies for different LUNs then Microsoft MPIO should be used.

– If you are using Windows XP or Windows Vista, MCS is the only option since Microsoft MPIO is only available with Windows Server SKUS.

NOTE: There does not exist a mechanism within the iSCSI protocol to determine whether a target is active/active or active/passive.

Load Balance Policies:

– Fail Over Only: No load balancing is performed. There is a single active path and the rest of the paths are standby paths. The active path is used for sending all I/O. If the active path fails then one of the standby paths is used. When the formally active path is reconnected it will become active and the standby path that was activated would return to standby.

– Round Robin: All paths are active paths and they will be used for sending I/O in a round robin fashion.

– Round Robin with a subset of paths: A set of paths are configured as active and a set of paths are configured as standby. I/O is sent in a round robin fashion over the active paths. If all of the active paths fail then one of the standby paths is used. If any of the formerly active paths become available again then the formerly active paths are used and the standby path that was activated becomes a standby path again.

– Weighted Path: Each path is assigned a weight and I/O will be sent on the path with the lowest weight. If the path with the lowest weight fails then the path with the next lowest weight will be used.

– Least Queue Depth: This is only supported by MCS. The path that has the fewest number of requests queued is the one where the I/O is sent.

NOTE: Windows does not support disks that have been formatted to anything other than a 512byte block size. Block size refers to the low level formatting of the disk and not the cluster or allocation size used by NTFS. Be aware that using a disk with a block size larger than 512 bytes will cause applications not to function correctly. You should check with your iSCSI target manufacture to ensure that their default block size is set to 512 bytes or problems will likely occur.

EMC & iSCSI –

A Look At EMC iSCSI Storage Systems (CLARiiON):

– EMC supports Microsoft Windows® 2000 and Microsoft Windows Server™ 2003 servers that run the native iSCSI Microsoft-certified driver for NICs. Supported devices include both onboard NICs in Microsoft-certified servers and PCI-based NICs that are Microsoft-certified.

– EMC supports Microsoft Windows 2000 and Microsoft Windows Server 2003 servers that use QLogic QLA4010 (optical) or QLA4010C (copper) HBAs and drivers.

– You cannot mix NICs and HBAs in the same server, even if they are connected to different storage systems.

– You must not connect a single server to both a CLARiiON® Fiber Channel storage system and an iSCSI storage system.

– Servers with HBAs and servers with NICs can connect to the same storage system.

– A single server can connect to CLARiiON CX-Series iSCSI storage systems and Symmetrix® iSCSI storage systems when a common network configuration, common failover software, and common driver support for both platforms exists.

– A single server can connect to CLARiiON AX-Series iSCSI storage systems, and through IP-to-FC switches, to CLARiiON AX-Series Fibre Channel storage systems when a common network configuration, common failover software, and common driver support for both platforms exists.

– A single server can connect to CLARiiON CX-Series iSCSI storage systems, and through IP-to-FC switches, to CLARiiON CX-Series Fibre Channel storage systems when a common network configuration, common failover software, and common driver support for both platforms exists.

– Using the CLARiiON Open Systems Configuration Guide (OSGC) definition of fan-in (server to storage system), you can connect a server to a maximum of four storage systems.

– Using the EMC Support Matrix (ESM) definition of fan-in (storage-system ports visible to a single initiator), you can connect an initiator to a maximum of 16 storage-system ports, but no more than four storage systems. The connection to the storage system must be 1-gigabit copper (RJ45).

– EMC does not support 10/100 NIC connections that are connected directly to the storage system, except for those connected to the management ports.

– Direct connections must be either with or 10/100/1000 NICs (operating at 1 gigabit) or QLA4010C HBAs. Ethernet crossover cables must be used with NICs to direct the server to the storage system.

– Using the OSCG and ESM definitions of fan-out (initiators per SP port), you can connect a maximum of 128 initiators to a CX-Series iSCSI SP port.

– If your service will not use iSNS, you must configure target storage-system addresses manually on the server initiators.

– You must configure server names and passwords manually on the iSCSI storage system. If you want authentication, you must use CHAP (Challenge Handshake Authentication Protocol).

– A CX-Series iSCSI storage system has two front-end (data) iSCSI ports per storage processor.

– EMC supports up to four HBAs or four NICs in one server that connects one CX-Series iSCSI storage system.

– Currently you cannot boot a Windows system using an iSCSI disk volume that the Microsoft iSCSI Software Initiator provides. The only currently supported method for booting a Windows system using an iSCSI disk volume is with a supported HBA.

– Microsoft iSCSI Software Initiator does not support dynamic disks.

– Microsoft iSCSI Initiator version 1.05a supports iSCSI Windows Server 2003 Cluster environments with a maximum of two nodes.

– The Microsoft iSCSI Initiator default configuration ignores multiple NICs on the same subnet. When multiple NICS are on the same subnet, use the Advanced button in the Log On to Target dialog box of the Microsoft iSCSI Software Initiator UI to associate a specific NIC with a specific SP port.

– Do not use Microsoft iSCSI Software Initiator to control the QLogic HBAs. QLogic’s SANsurfer utility is the only supported interface to HBAs.

– A CX-Series iSCSI storage system does not support Microsoft iSCSI Software Initiator version 1.05a configured for MPIO, CRC/Checksum Data digest, or Header digest.

– Supported Configurations:

- Servers’ with Single NIC/HBA & 1 Subnet

- Servers’ with Multiple NICs/HBAs & 1 Subnet

- Servers’ with Multiple NICs/HBAs & Multiple Subnets

- Servers with Multiple NICs/HBAs & Direct Connections

- Multiple NICs/HBAs to Multiple Subnets, Routed or Independent (Including Direct Connections) is supported.

NOTE: A high hop count can also contribute to performance degradation. Performance anomalies can also result for reasons associated with the various inherent TCP/IP flow control algorithms such as delayed ACK, slow start, and Nagle.

NOTE: You can use an iSCSI analyzer to perform protocol analysis of traffic flowing into and out of any suspect port on the storage system.

NOTE: You must install the Microsoft iSCSI Software Initiator because the Navisphere Server Utility uses it to configure iSCSI connections. You must install the Initiator Service option of the Microsoft iSCSI Software Initiator because the QLogic driver requires it.

NOTE: PowerPath iSCSI is no longer available for CX3 series and CX series storage systems. PowerPath 4.5.1 or earlier Do not select Microsoft MPIO Multipathing Support for iSCSI. Do not select Microsoft MPIO Multipathing Support for iSCSI or Software Initiator.

NOTE: You can improve the performance of any NICs that will be used primarily for iSCSI traffic rather than general network traffic by changing the network settings so that NICs immediately acknowledge incoming TCP segments. If you are running a version of the Navisphere Server Utility that is earlier than 6.24.1.4.0, you need to manually modify the TCP/IP registry settings, as described below, to improve performance. If you are running Navisphere Server Utility version 6.24.1.4.0 or later, the system will prompt you to change these settings when you configure the network parameters for your NICs (set up iSCSI connections).

NOTE: When you remove an iSCSI target, the specified target and all other targets on the storage system will be removed. If you want to remove a specific target but not all targets on the storage system, you must use the Microsoft Software Initiator.

VMware & iSCSI –

– VI3 uses single connection for a session

– At present, the VMware software initiator does not support jumbo frames. And until 10 gigabit Ethernet is supported by the VMware software initiator, the performance benefit of using jumbo frames would be minimal.

– The software-initiator iSCSI implementation leverages the VMkernel to perform the SCSI to IP translation and does require extra CPU cycles to perform this work. As a result, software iSCSI can reduce overall server performance when CPUs are under heavy load.

– Don’t use VMware Consolidated Backup over iSCSI

– Best practice is to have a dedicated LAN for iSCSI traffic and not share the network with other network traffic. It is also best practice not to oversubscribe the dedicated LAN.

– VMkernel has a single routing table for all its VMkernel Ethernet interfaces

– Make sure both the VMotion and IP Storage network and the service console port connection have appropriate IP addresses and are routed properly to the array.

– The VMware VMkernel IP networking stack has been extended to handle the following functions:

- iSCSI as a virtual machine datastore (new in ESX Server 3)

- NFS as a virtual machine datastore (new in ESX Server 3)

- NFS for the direct mounting of ISO files, which are presented as CD-ROMs to virtual machines

- Migration with Vmotion

– Make sure both the VMotion and IP Storage network and the service console port connection have appropriate IP addresses and are routed properly to the array.

– The IP address that you assign to the service console during installation must be different from the IP address that you assign to VMkernel’s IP stack from the Configuration > Networking tab of the Virtual Infrastructure Client. The NFS and iSCSI functions must be configured together. They always share the same IP address, gateway, netmask, and other parameters. They are connected to the same virtual switch and, therefore, to the same physical Ethernet adapter. Before configuring software iSCSI for the ESX Server host, you need to open a firewall port.

– Metadata Updates – A VMFS holds files, directories, symbolic links, RDMs, and so on, along with corresponding metadata for these objects. Metadata is accessed each time the attributes of a file are accessed or modified. These operations include, but are not limited to:

- Creating, growing, or locking a file.

- Changing a file’s attributes.

- Powering a virtual machine on or off.

CAUTION After you create a new VMFS volume or extend an existing VMFS volume, you must rescan the SAN storage from all ESX Server hosts that could see that particular volume (LUN). If this is not done, the shared volume might become invisible to some of those hosts.

– Levels of Indirection – If you’re used to working with traditional SANs, the levels of indirection can initially be confusing.

- You cannot directly access the virtual machine operating system that uses the storage. With traditional tools, you can monitor only the VMware ESX Server operating system (but not the virtual machine operating system). You use the VI Client to monitor virtual machines.

- Each virtual machine is, by default, configured with one virtual hard disk and one virtual SCSI controller during installation. You can modify the SCSI controller type and SCSI bus sharing characteristics by using the VI Client to edit the virtual machine settings. You can also add hard disks to your virtual machine.

- The HBA visible to the SAN administration tools is part of the ESX Server system, not the virtual machine.

- Your ESX Server system performs multipathing for you. Multipathing software (such as PowerPath) in the virtual machine is not supported (and not required).

– Choosing Larger or Smaller LUNs:

Plan how to set up storage for your ESX Server systems before you perform installation.

- One large LUN or many LUNs with a single VMFS volume spanning all LUNs: You might want fewer, larger LUNs for the following reasons:

- More flexibility to create virtual machines without asking the SAN administrator for more space.

- More flexibility for resizing virtual disks, doing snapshots, and so on

- Fewer LUNs to identify and manage

- Many LUNs with one VMFS volume on each LUN: You might want more, smaller LUNs for the following reasons:

- Less contention on each VMFS because of locking and SCSI reservation issues.

- Different applications might need different RAID characteristics.

- More flexibility (the multipathing policy and disk shares are set per LUN).

NOTE: You can divide your datacenter into servers that are best configured with fewer, larger LUNs and other servers that use more, smaller LUNs.

NOTE: You can boot from a SAN only with ESX Server 3 and with hardware iSCSI.

NOTE: If you plan to use NIC teaming to increase the availability of your network access to the iSCSI storage array, you must turn off port security on the switch for the two ports on which the virtual IP address is shared. The purpose of this port security setting is to prevent spoofing of IP addresses. Thus many network administrators enable this setting. However, if you do not change it, the port security setting prevents failover of the virtual IP from one switch port to another and NIC teaming cannot fail over from one path to another. For most LAN switches, the port security is enabled on a port level and thus can be set on or off for each port.

NOTE: SCSI reservations are held during metadata updates to the VMFS volume. ESX Server uses short‐lived SCSI reservations as part of its distributed locking protocol.

NOTE: VMware recommends that you load balance virtual machines over servers, CPU, and storage. Run a mix of virtual machines on each server so that not all experience high demand in the same area at the same time.

NOTE: Whether a virtual machine can run management software successfully depends on the storage system in question.

El almacenamiento en Hyper-V (v 1.1)

Introducción

Continuando con la serie de artículos que empecé con el articulo sobre como escoger un host equilibrado, los procesadores y la memoria, hoy os hablare del almacenamiento y la idea es cerrar esta serie con un articulo sobre redes.

En un entorno no virtualizado la carga del almacenamiento se distribuye entre la SAN y el almacenamiento local de los servidores, mientras que en un entorno virtualizado lo mas probable es que la SAN absorba prácticamente toda la carga.

Desgraciadamente la virtualización no siempre va acompañada de un análisis adecuado y gracias a la potencia de las tecnologías de hoy en día podemos tener la sensación de que la virtualización es un saco que lo aguanta todo, que no hay que tener cuidado, sin embargo mas tarde o mas temprano tendremos que poner la atención en diferentes elementos de nuestra plataforma si es que quieres que esta pueda seguir asumiendo carga y mantener el rendimiento dentro de unos parámetros aceptables.

La verdad es que con mucho considero el almacenamiento el aspecto mas complicado de la virtualización, la cantidad de elementos que intervienen es amplísima empezando por las cabinas en constante evolución gracias a un mercado súper-competitivo en el que como dice mi compañero David Cervigón cuyo conocimiento sobre estos temas es mas que envidiable “en el almacenamiento todo esta por hacer”.

En cuanto al almacenamiento en la virtualización existen dos corrientes de pensamiento básicas:

1) Estandarizar una configuración determinada, llenarla mientras aguante, escalar cuando sea necesario para mantener un rendimiento aceptable

Contras:

-Hay cargas que es complicado virtualizar de esta forma, especialmente las que hagan uso intensivo de disco.

-Las implicaciones terminan apareciendo desde el punto de vista de backups/recuperaciones, rendimiento no predecible, etc.

-Para mitigar en cierta forma el problema se puede terminar moviendo frecuentemente los discos de las VMs lo que al final es menos eficiente que pensar en ello desde el principio

-A medio o largo plazo se termina teniendo que replantearse el almacenamiento o comprar sistemas mas potentes que nos den margen durante mas tiempo

PROS:

-Es un sistema simple y rápido a primera vista

-Puede funcionar sin problemas en muchos entornos cuyas infraestructuras de almacenamiento están sobredimensionadas.

2) Estandarizar las configuraciones apropiadas para obtener desde el principio un rendimiento predecible y optimizado, lo que requiere conocer y analizar diferentes aspectos del almacenamiento

Contras:

–Requiere algo mas de tiempo y conocimientos para el análisis

-Puede suponer un mayor numero de volúmenes y espacio consumido al principio de los proyectos

PROS:

-Una vez realizado el trabajo inicial es fácil de mantener

-Evita problemas con el tiempo siendo una arquitectura predecible

-El rendimiento general es mejor y sostenible

Si me preguntarais por mi opinión personal os diría que en general soy partidario de la segunda opción,.

Dado que este tema es difícil de entender solo escuchando una sesión técnica cosa que hago muy a menudo, he decido escribir este post de forma que pueda servirme de apoyo al explicarlo y esperando que os sea de utilidad a todos los que terminéis aquí por alguna razón.

Aviso: Cada cabina es un mundo y el numero de combinaciones entre discos, arquitecturas, conectividad y parametrización es infinita así que todas las cifras que muestro en este articulo son para los sistemas específicos en los que he realizado las pruebas o de aquellos cuya información he visto reflejada en diferentes pruebas realizadas por Microsoft o los fabricantes, cada entorno insisto tendrá sus propias cifras. En este articulo hablaremos también de como averiguar las cifras actuales de tu entorno y como realizar mediciones del impacto de los cambios que hagas.

Que vamos a ver en este articulo:

- Conceptos generales sobre almacenamiento

- Patrones de uso

- El tipo de interface de disco

- El Disco

- Las LUNs y las cabinas

- El RAID y el tamaño de banda

- Formateando nuestros discos (GPT vs MBR, el “unit allocation size”)

- Evitando problemas de alineamiento

- Conoce tu hardware

- Aprende a probar el rendimiento del almacenamiento

- El almacenamiento en Hyper-V

- Haciendo las cosas bien: la importancia del análisis

- De físico a virtual

- Encriptación y compresión

- Arranque desde SAN

- ¿Que dispositivos de almacenamiento puedo usar con Hyper-V?

- MPIO

- Usando iSCSI

- Tipos de discos en las maquinas virtuales

- Todo lo que tienes que saber sobre CSV y otros tipos de discos en los hosts

- Diseñar los discos duros virtuales de las VM

- Los limites de Hyper-V para hosts y VMs

- ¿Necesitas aun mas rendimiento?

Conceptos generales sobre el almacenamiento

Para que podáis sacar el mayor partido del articulo tengo que asegurarme de que conocéis algunos conceptos fundamentales del almacenamiento que muchas veces son pasados por alto, conocerlos os será igual de útil en entornos físicos que virtuales incluso con diferentes fabricantes de virtualización.

Patrones de uso

Dentro de un servidor existen a parte del sistema operativo aquellos servicios responsabilidad del servidor.

Cada uno de estos servicios hace un uso diferente del disco duro, de esta forma no es lo mismo el uso de un disco duro de un servidor de base de datos de un ERP que de un servidor de ficheros.

En base a estos diferentes tipos de uso podemos hablar de unos patrones que están formados por los siguientes elementos:

Escritura/lectura: Por ejemplo un servidor de ficheros suele ser un 80% lectura contra un 20% escritura, mientras que un servidor web generalmente será un 100% lectura.

Secuencial/aleatorio: Un servidor de streaming de video será 100% secuencial y normalmente todos los servidores que muevan grandes volúmenes de datos en bloque tenderán a ser secuenciales y los datos se leerán o escribirán de seguido, por ejemplo una base de datos será en muchas ocasiones aleatoria pues los datos estarán muy dispersos.

Tamaño de la operación: Por ejemplo muchas veces un sistema determinado como por ejemplo Exchange o SQL Server suelen siempre leer del disco bloques del mismo tamaño por ejemplo dependiendo del producto 8KB,32KB o 64KB, mientras que un servidor de ficheros solicitara bloques de muy diferentes tamaños donde a lo mejor las solicitudes de bloques de 64KB suponen el 10% de las operaciones y las de 16KB el 4% y así.

A cada operación de lectura o escritura a realizar la llamamos IO, las IO por segundo serán las IOPS.

En este articulo vamos a ver muchos parámetros que afectan al rendimiento del almacenamiento el primer paso para tomar buenas decisiones es entender el patrón de uso de tus servidores lo que puedes empezar haciendo con el performance monitor y tantas otras herramientas.

La siguiente tabla muestra ejemplos de algunos patrones estándar:

El tipo de interface

Es cierto que iSCSI esta creciendo mucho y creo que todos estamos muy contentos con iSCSI, solo tengo que decir que cuando vayamos a utilizar iSCSI tenemos que hacerlo de forma adecuada aislando y dimensionando adecuadamente las redes de iSCSI, utilizando Jumbo frames y otras optimizaciones que nos harán sacar el máximo partido de esta tecnología que nos aporta tanta flexibilidad.

Es muy común encontrarnos con fibra óptica (FC) que también es estupenda.

Para vuestro conocimiento aquí tenéis una tabla con el rendimiento teórico de diferentes tipos de arquitectura de almacenamiento.

| Arquitectura | Rendimiento (Máximo Teórico – Megabyte/sec) |

| iSCSI (Gigabit Ethernet) | 125 MB/s |

| Fibre Channel (2 GFC) | 212.5 MB/s |

| SATA (SATA II) | 300 MB/s |

| SCSI (U320) | 320 MB/s |

| SAS | 375 MB/s |

| Fibre Channel (4 GFC) | 425 MB/s |

Hoy en día empezamos también a ver interfaces de 10 Gigabit que usados para iSCSI o FCOE pueden dar rendimientos fantásticos como veis en el siguiente grafico:

El disco

Muchas SAN nos permiten elegir diferentes tipos de discos y luego poder crear diferentes grupos de discos con ellos.

Las ultimas cabinas de algunos fabricantes incluso son capaces de juntar en el mismo grupo diferentes tipos de discos y mover los bloques de datos a aquellos discos donde mejor estén, teniendo en cuenta la frecuencia de uso y patrón del mismo.

A la hora de escoger los discos estaremos impactando dos cosas principalmente; coste y rendimiento.

Un aspecto determinante a la hora de escoger el disco son las revoluciones del mismo (RPM), las velocidades mas comunes en entorno de servidores son 7200, 10000 y 15000RPM.

Las revoluciones tienen además otras connotaciones en los discos como podéis ver en las siguientes imágenes, esto implica por tanto que no solo los discos giran mas rápido sino que los platos son mas pequeños y las agujas se tienen que desplazar menos.

El siguiente grafico muestra el numero de operaciones en disco aleatorias de 8K que he obtenido en diferentes discos según sus revoluciones (en este grafico mas es mejor).

Si a alguno os intriga cuantas IOPS tiene un disco de estado solido (SSD) podríamos decir que hay quien las sitúa entorno a las 6000!!

El siguiente grafico os muestra la diferencia entre discos de 15K RPM y 10K RPM de tipo SCSI en el escenario concreto de lecturas secuenciales de bloques de 8K, añado también un disco SATA de 10K para que veáis también el impacto que tiene SATA vs SCSI. (En este grafico mayor latencia es peor mientras que mas lecturas por segundo es mejor).

Esto no significa que todos los discos tengan que ser de 15K por que son mejores, simplemente que debemos entender la diferencia y en ocasiones elegir que conviene mas.

Las LUNs y las cabinas

Una LUN (Logical Unit Number) es un disco virtual proporcionado por la SAN y que presentamos a uno o mas hosts.

Fijaros que digo “virtual” esto es así porque la LUN no tiene por que representar un disco físico conectado a la cabina, normalmente todas las cabinas reúnen grandes grupos de discos físicos incluso de diferente configuración y sobre estos generan estas unidades repartiendo los bloques que las componen entre los diferentes discos físicos, de esta forma se obtiene mejor rendimiento.

Algunas SAN aportan funcionalidades adicionales, como crear las LUN usando un modo que se llama “thin”, lo que hace que la unidad vaya ocupando espacio en la SAN a medida que se vaya usando, este tipo de LUNs están creciendo en popularidad, sin embargo os tengo que decir que dependiendo de la cabina esto puede suponer una pequeña penalización y os sugiero que establezcáis un baseline comparando el rendimiento de la misma carga con una LUN “thin” y otra normal de forma que conozcáis el impacto exacto en vuestro entorno a la hora de tomar vuestras decisiones.

Otra funcionalidad de algunas SAN muy interesante es la llamada deduplicación con la cual la SAN ahorra el espacio de los bloques que se encuentren almacenados en la SAN mas de una vez, como esto se realiza a nivel de bloque los ahorros pueden ser muy importantes ya que por ejemplo en un entorno VDI la mayor parte de los discos duros virtuales puede ser prácticamente igual. Una vez mas con esta funcionalidad recomiendo hablar con el fabricante para entender las buenas practicas que recomiende y tener especial cuidado con el impacto que esto tiene en la CPU y resto de recursos de nuestra cabina.

A medida que aumentamos discos en un grupo de discos de las SAN también aumentamos el numero de operaciones de entrada y salida (IOPS) que nos da la cabina.

El siguiente grafico muestra los datos para un fabricante determinado.

Las cabinas también avanzan a un ritmo tremendo así con cada versión y modelo los fabricantes añaden mas cache, mejores firmwares y elementos que aumentan el rendimiento, por eso elegir la cabina y comparar varias tiene mucha importancia.

El siguiente grafico muestra la diferencia entre dos cabinas del mismo fabricante pero de diferente gama, con discos con las mismas RPM e igual numero de discos (240)

El RAID

Otra aspecto a comentar es el nivel de RAID, como sabéis RAID tiene diferentes niveles, 0,1,2,3,4,5,6,5E, 6E, 0+1, 1+0, 30, 100, 50 y un buen numero mas de combinaciones y especificaciones propietarias, siendo los mas comunes de encontrar los raid 1 y 5 y limitando cada cabina que RAIDs puedes configurar.

RAID 1: Los datos se escriben en dos discos, generalmente mejora lecturas dado que puedes leer de dos sitios pero degrada la escritura por la misma razón aunque el rendimiento de escrituras pequeñas es muy bueno.

Dado que por cada disco perdemos otro es un RAID muy caro

RAID 5: Buen rendimiento en lecturas pero malo en pequeñas escrituras, es mas barato por que pierdes menos discos que con RAID 1, en caso de fallo de un disco todo el rendimiento se ve afectado.

Fijaros en que puntualizo el aspecto de escrituras pequeñas dado que tiene mucha importancia de forma especial en discos que por ejemplo dediquéis a logs, en general las escrituras se ven perjudicadas por el RAID, el siguiente grafico muestra la penalización en discos de 15K RPM:

Los RAID tienen repercusiones tanto a nivel de tolerancia a fallos permitiendo al sistema sobrevivir a la perdida de algún disco que componga el RAID como a nivel de rendimiento, cada nivel tiene ventajas y desventajas, unos favorecen las lecturas otros las escrituras, unos las cargas secuenciales y otros las aleatorias incluso se puede hablar de impacto en CPU o diferencias según la cantidad de datos que se quieran mover en las operaciones.

Muchas cabinas implementan siempre cierto nivel de RAID a bajo nivel y normalmente esto no se puede elegir, por otra parte algunas cabinas ya no dejan elegir el nivel de RAID individual para las LUN, deciros que ese uso de cierto nivel de RAID a bajo nivel en muchas cabinas no esta reñido con que la LUN tenga además un nivel de RAID adicional.

Es cierto que las caches de las controladoras puede alterar estos rendimientos. En cualquier caso debéis hacer vuestras propias mediciones para entender las diferencias entre RAIDs que os da vuestra SAN.

Aunque todo es discutible, por norma general podríamos decir que RAID 1 es adecuado para los discos de sistema operativo y logs transaccionales mientras que RAID 5 o RAID 10 es mejor para discos de datos.

Hay mil recursos en internet para aquellos que tengáis dudas sobre RAID, yo de momento solo quiero que os quedéis con las diferencias de rendimiento entre cada uno.

Tamaño de banda

Cuando generas un RAID podríamos decir que los discos se parten en bandas o franjas, estas franjas tienen un tamaño y aunque no todas las cabinas permiten especificarlo este parámetro también tiene impacto en el rendimiento.

El siguiente grafico os muestra el impacto en el rendimiento del tamaño de franja con tres opciones de tamaño teniendo como base la prueba las lecturas aleatorias de bloques de 8K.

Como veis configurar apropiadamente el tamaño de franja nos proporciona un potencial beneficio en rendimiento nada desdeñable.

La gran pregunta es ¿como decido el tamaño de franja adecuado?, pues bien como con todo lo que tiene que ver con almacenamiento no hay una respuesta única.

Para tomar una decisión tendremos que entender esos patrones de uso de los que hablábamos al principio del articulo y buscar si los fabricantes de los sistemas que vayan a utilizar los discos nos han hecho alguna recomendación especifica, por ejemplo en el caso de Exchange 2010 el tamaño recomendado es de 256.

Un tamaño de banda pequeño suele favorecer la transferencia mientras que uno grande favorece que se puedan realizar múltiples operaciones en paralelo a lo largo de varios discos en la misma franja lo que beneficia a las bases de datos.

El tamaño de la banda tiene también un efecto multiplicador de IOPS una única IO que al llegar a la controladora de la cabina tenga que responderse con datos que estén en mas de una banda se convertirá en varias IOs vistas desde la SAN.

Las cabinas establecen normalmente un valor optimizado de forma general por el fabricante muchos clientes no se preocupan del tamaño de la franja hasta que no tienen que superar un problema de rendimiento, es algo a vuestra elección.

Formateando nuestros discos (GPT vs MBR y unit allocation size)

Cuando vamos a formatear un disco duro se nos pregunta si queremos hacerlo con un esquema de particionamiento GPT o con MBR.

MBR es él esquema estándar de toda la vida, nos permite 4 particiones primarias por volumen y un tamaño máximo de 2TB.

GPT podríamos decir que permite un tamaño casi ilimitado, pero que Windows limita a 256TB por partición con un máximo de 128 particiones.

GPT también añade algunas funcionalidades y otras restricciones (mas detalles en: http://msdn.microsoft.com/en-us/windows/hardware/gg463524 )

Yo por defecto aunque GPT tiene algunas ventajas os recomiendo usar MBR siempre salvo que necesitéis mas de 2TB y en ese caso mirar que no tengáis ninguna peculiaridad en los requisitos de vuestra configuración que os pueda dar algún problema.

El “unit allocation size” , cluster size o tamaño de bloque es otro de los parámetros que se nos pide a la hora de formatear un disco.

Este parámetro representa la menor cantidad de espacio en disco que un fichero puede consumir de forma contigua, el valor por defecto es 4096 bytes, por lo tanto cada vez que se accede al disco se producen tantas operaciones como bloques de este tamaño se tengan que leer para completar el volumen de datos pedidos.

Por ejemplo imaginar una carga como SQL Server donde podemos leer bloques de 64KB (65.536 bytes) si nuestra configuración de bloque es la configuración por defecto 4096 bytes, el sistema tendrá que usar muchas operaciones de 4096 bytes para completar los 64KB sin embargo si tuviéramos un tamaño de bloque de 64KB seria una sola operación.

Puedes saber el tamaño de bloque de un disco con el comando “fsinfo”

Modificar el tamaño de bloque según el patrón de uso puede tener un impacto que a veces no podemos dejar pasar por alto, el siguiente grafico os muestra como afecta el tamaño de bloque a la cantidad de MB por segundo que puede mover un servidor:

Por cierto como es lógico un tamaño de bloque muy grande repercute en menos espacio libre en disco.

Evitando problemas de alineamiento

Hasta ahora habéis visto en este articulo muchos parámetros relativos al almacenamiento, creo que todos los básicos al menos.

Ahora nos falta el que mas impacto puede tener y que se ve afectado por varios de los vistos hasta ahora, este otro aspecto es el que denominamos alineamiento.

Tratare de simplificar tanto como pueda al explicaros el problema de alineación.

Como hemos visto el sistema trata de escribir y leer en bloques de un tamaño ajustando este tamaño a las cargas reducimos las operaciones de disco necesarias para leer o escribir el volumen de datos que sea necesario, el asunto es que estos bloques de información son escritos físicamente en los bloques del disco (sectores) que aunque ya no siempre es así son de 512 bytes, si ambos elementos no están alineados, la lectura de un bloque en vez de producir una IO producirá varias a nivel físico.

Para alinear un disco es necesario que coincida el primer bloque con el comienzo de un sector, para conseguir esto se establece un “offset” o desplazamiento que es un espacio perdido (y algunas otras cosas) a partir del cual se empieza a escribir y que vale para alinear el disco.

Una correcta alineación de los discos puede suponer hasta un 30% de aumento de rendimiento.

Este articulo trata en el fondo de Hyper-V que siempre corre sobre Windows Server 2008 o superior, en Windows Server 2008 por defecto se emplea una alineación de 1024K.

Algunos sistemas podrían funcionar mejor con otros offsets, para averiguar si es tu caso consulta primero la información del fabricante de la cabina por si hace alguna recomendación.

Para saber cual es el offset de una unidad puedes usar WMI ( http://support.microsoft.com/kb/929491 )

Conoce tu hardware

Cabinas y controladoras tienen muchas veces parámetros que pueden mejorar sustancialmente el rendimiento.

Por ejemplo muchas controladoras incorporan caches que están configurados por defecto para un patrón de uso estándar, modificar este parámetro para adaptarlo al uso que preveas, puede traerte mejoras de rendimiento muy apreciables.

Aprende a probar el rendimiento de tus configuraciones de almacenamiento

La mejor forma de alcanzar las mejores combinaciones de parámetros es ser capaz de medir el rendimiento con cada combinación que quieras probar.

Una manera de hacerlo es con la herramienta IOMeter: http://sourceforge.net/projects/iometer/

Hay herramientas especificas para cargas como Exchange (Jet Stress) o SQL Server (SQL IO) que te permiten simular la presión de IO exacta de tus requisitos para estas cargas.

Es un proceso laborioso, si quieres sacarle partido resérvate el tiempo adecuado y prepárate una buena hoja de calculo para ir apuntando los resultados y las conclusiones de cada prueba

El almacenamiento en Hyper-V

Lo primero felicitarse si has llegado hasta aquí ![]() ahora si me he explicado adecuadamente tienes en la cabeza los conceptos que necesitas para entender el rendimiento del almacenamiento y por tanto podemos hablar ya de las peculiaridades de la virtualización con respecto a el.

ahora si me he explicado adecuadamente tienes en la cabeza los conceptos que necesitas para entender el rendimiento del almacenamiento y por tanto podemos hablar ya de las peculiaridades de la virtualización con respecto a el.

Haciendo las cosas bien: La importancia del análisis

Has visto como para cada patrón de uso hay unos parámetros que benefician su rendimiento y otros que lo perjudican.

La virtualización ha venido de la mano de la estandarización en la parametrización del almacenamiento, mientras que hace años a la hora de poner un servidor de bases de datos en una gran empresa un DBA cualificado junto con un técnico de almacenamiento especializado en el fabricante de la cabina analizaban los mejores parámetros y se definían las LUNs adecuadas, RAIDs, tamaños de cluster, bandas, etc, etc. ahora generamos grandes LUNs en las cabinas todas con los mismos parámetros y colocamos encima decenas de discos duros virtuales.